La inteligencia artificial, está presente en nuestro día a día más de lo que somos conscientes. Desde nuestro Smartphone con su asistente de voz, hasta los filtros de spam de nuestro correo electrónico, que diferencian entre correos legítimos y spam empleando aprendizaje automático.

Vivir con la influencia sutil de inteligencia artificial tiene un impacto social positivo, pero también una cara B menos visible sobre la que nos proponemos reflexionar en este post para identificar un marco ético que garantice el bienestar de todos.

La cara A: El impacto positivo de la IA en la sociedad

En el ámbito sanitario por ejemplo, los sistemas de IA ayudan a la prevención y diagnóstico de enfermedades y brotes en fases muy tempranas, descubriendo tratamientos y medicamentos u ofreciendo intervenciones a medida.

Otro de los grandes beneficios que ha aportado a la sociedad la IA, es que ha ayudado a una reducción de la desigualdad y la pobreza, como es en el caso de la agricultura, al permitir que los agricultores conozcan los precios justos y los cultivos rentables, dándoles también acceso a las predicciones meteorológicas.

- La mecanización de los procesos sin intervención humana

- Favoreciendo las tareas creativas

- Añadiendo precisión

- Disminuyendo el error humano

- Incrementando el ciclo de vida del equipamiento

- Mejorando la toma de decisiones de forma rápida y eficiente

- Control y optimizando procesos productivos y líneas de producción

- Aumentando la productividad y calidad del trabajo

- Ayudando a superar desafíos complejos

La cara B: Riesgo de perpetuar desigualdades sociales

A pesar de los múltiples beneficios que nos aporta la inteligencia artificial, también encontramos una cara B que nos trae nuevos tipos de preocupaciones en cuanto a ética y justicia.

En el sector de la IA, existe desde el inicio una crisis de diversidad de género y raza que tiene un impacto directo en nuestra sociedad, que si bien se va reduciendo a medida que se toman acciones, no se ha erradicado. Los ejemplos que recopilamos en este artículo son casos reales de inteligencia artificial que hubo que parar debido a sus sesgos de género.

Si sabemos que el 80% de quienes desarrollan IA son hombres blancos, no es difícil predecir que existirá un sesgo de género en los algoritmos, pero también de raza y de poder.

Estos 2 ejemplos de grandes tecnológicas lo corroboran:

- En abril de 2019, los empleados de Microsoft se reunieron con su CEO Satya Nadella para discutir sobre problemas como el acoso, la discriminación, la compensación injusta y la falta de promoción de mujeres en la empresa.

- En noviembre de 2018, hubo en Google una huelga mundial histórica de 20.000 empleados por una cultura de inequidad y casos de acoso dentro de la empresa.

Esto que a priori pareciera afectar solo al funcionamiento interno de las empresas de inteligencia artificial, se trasladan también a sus productos, principalmente a aquellos que aprenden de la cultura como la IA.

Crisis de diversidad en el sector de la IA

El sector de la IA está trabajando en un cambio profundo en la forma en que aborda la actual crisis de diversidad. Muchos investigadores han demostrado que el sesgo en los sistemas de IA refleja patrones históricos de discriminación.

Hasta la fecha, los problemas de diversidad en la industria de la inteligencia artificial y los problemas de sesgos en los algoritmos se han tratado por separado, pero ambos están entrelazados.

Muchos algoritmos de inteligencia artificial funcionan como un sistema de discriminación. Por ejemplo, hubo sonados casos donde el reconocimiento de la imagen facial identifica como erróneos algunos rostros negros, pudiendo desviar la toma de decisiones hacia un impacto negativo en la vida de estas personas.

Aquí es donde surgen cuestiones como: ¿Quién se ve perjudicado? ¿Quién se beneficia? Quien decide ¿pertenece al grupo de los perjudicados o los beneficiados?

Estas preguntas son fundamentales en la construcción social de ideas acerca de cuál es la persona “con rasgos normativos” y cuál no lo es. La clave entonces, no pasaría por hacer foco solo en cómo la IA puede perjudicar a algunas personas, sino también en cómo funciona en beneficio de otras.

Actualmente hay una corriente de inteligencia artificial responsable en el marco de «tecnología con impacto», gracias a la cual el sector se encuentra trabajando a conciencia para que se integren estas preocupaciones en el desarrollo de los distintos tipos de algoritmos de inteligencia artificial, buscando no solo la eficiencia sino garantizar la justicia y la responsabilidad social.

El impacto de la IA en grupos desfavorecidos

A veces puede resultar complicado imaginar un concepto abstracto como «sesgo» operando en un caso real. Este ejemplo de Amazon puede ayudarte a entender el impacto real de un sesgo de IA en algo tan importante como el acceso a oportunidades laborales:

En 2018, Reuters informó que Amazon había desarrollado una herramienta de contratación experimental para ayudar a clasificar a los candidatos a puestos de trabajo, aprendiendo de sus experiencias pasadas. Se esperaba que la herramienta de escaneo de currículums pudiera clasificar según sus trabajos anteriores.

Pero el sistema empezó a degradar a solicitantes que habían pasado por universidades de mujeres, junto con cualquier CV que incluyese la palabra mujer. Tras descubrir este sesgo, los ingenieros de Amazon, trataron de solucionarlo haciendo que se tratase la palabra mujer de forma neutral.

La empresa finalmente dejó de utilizar esta herramienta al no poder garantizar 100% que el algoritmo funcionase de forma correcta.

Este ejemplo del algoritmo de inteligencia artificial de Amazon, es solo uno de muchos que muestran como las lógicas funcionales de una determinada aplicación de la IA se hace eco de la discriminación racial y de género presente en la cultura de la industria que la ha producido.

Este ejemplo del algoritmo de inteligencia artificial de Amazon, es solo uno de muchos que muestran como las lógicas funcionales de una determinada aplicación de la IA se hace eco de la discriminación racial y de género presente en la cultura de la industria que la ha producido.

Por lo tanto, si los productos de la inteligencia artificial ya influyen en aspectos trascendentes de la vida de miles de personas, deben garantizar la equidad. No solo para las superpotencias de la inteligencia artificial en la industria tecnológica sino también para todas las personas que usamos aplicaciones y servicios de inteligencia artificial de uso popular.

Discriminación en los sistemas de Inteligencia artificial

La discriminación y la inequidad en temas laborales tienen consecuencias graves, ya que excluye sistemáticamente a grupos determinados de las oportunidades y la capacidad de generar recursos que les den autonomía.

Pero otros ámbitos como la justicia y la seguridad pueden tener un impacto más directo en la vida de las personas más desprotegidas, si la tecnología no contempla su vulnerabilidad.

Por ejemplo, la IA empleada en el servicio de la policía en EEUU, es un foco de estudio sobre sesgos ya que pueden perjudicar de forma desproporcionada a las personas pobres y a la comunidad negra debido a los problemas de discriminación de su sociedad.

La representación de los rostros humanos en la IA, es un reflejo de la jerarquía social en la que opera ya que personas con recursos económicos inferiores, tienen un acceso limitado a la tecnología y por lo tanto están peor representadas en los modelos de aprendizaje de los algoritmos.

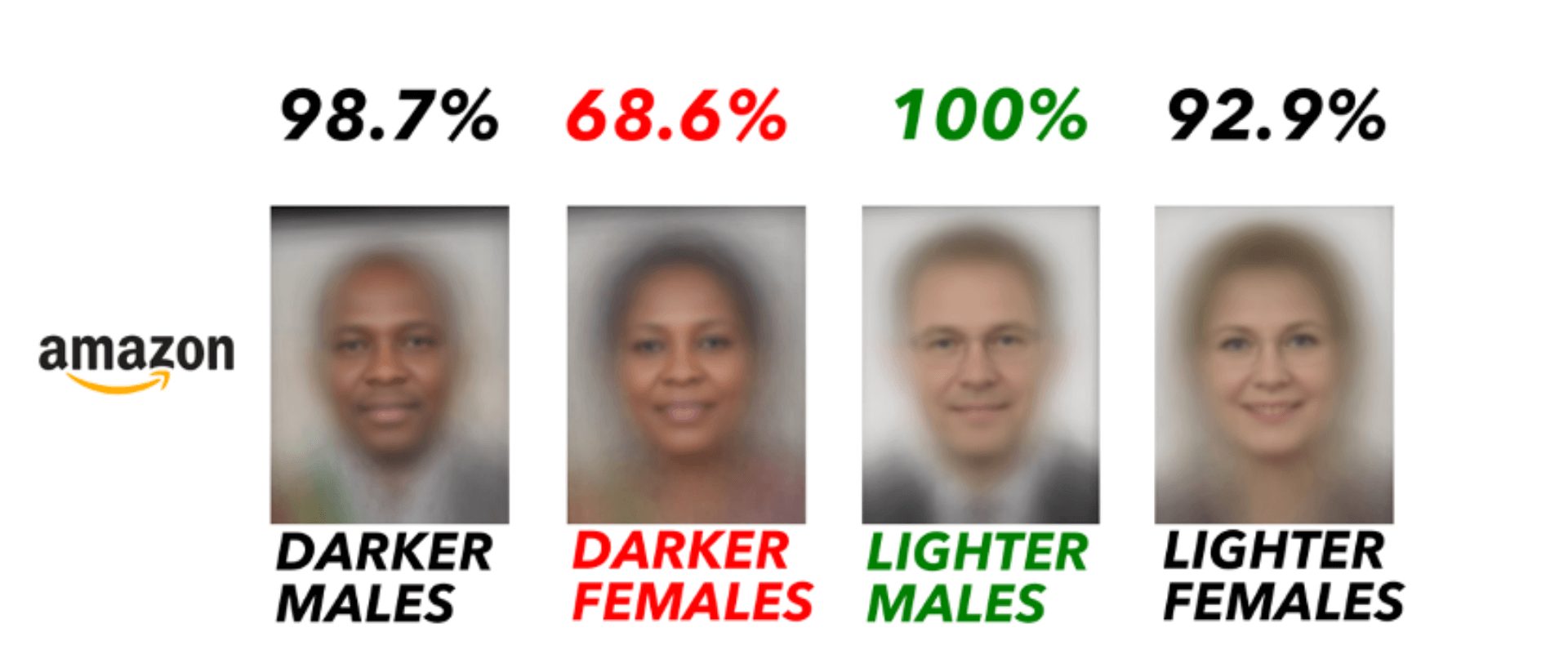

El caso de IA Rekognition de Amazon:

Un claro ejemplo es el caso del software de Amazon, y su servicio de IA Rekognition para analizar rostros. Investigadores pidieron que se dejara de vender este servicio de inteligencia artificial Rekognition a los departamentos de policía, ya que, tenía tasas de error muy altas al predecir el género de las mujeres de piel más oscura en las imágenes, en comparación con los hombres de piel más clara:

Te dejamos a continuación otro ejemplo, en este caso de la empresa Uber:

Otro problema que parece pasar desapercibido, a tener en cuenta en los sistemas de reconocimiento facial, es reconocer los rostros de las personas que atraviesan una transición de género.

Este error ha sido un gran problema para los conductores trans de UBER, ya que sus sistemas de inteligencia artificial de reconocimiento facial que se encuentran integrados como seguridad, han provocado la suspensión de las cuentas de los conductores trans, y les ha impedido trabajar hasta recuperar dichas cuentas.

La gran mayoría de estudios sobre Inteligencia Artificial asumen el género como binario, (hombre o mujer) excluyendo a estos grupos, borrando todas las demás formas de identidad de género.

Estos casos reales han sido una llamada de atención clara que ha llevado a las grandes tecnológicas a enfocarse en crear algoritmos de IA que tengan en cuenta aspectos como la diversidad y la inclusión desde una perspectiva de equidad.

IA en la educación

La Inteligencia Artificial irrumpe en el ámbito educativo con un enorme potencial para transformar la enseñanza y el aprendizaje. Su capacidad para personalizar el contenido, evaluar con precisión, aumentar la motivación y brindar accesibilidad a la educación abre un mundo de posibilidades para mejorar la calidad educativa.

Sin embargo, esta transformación también presenta desafíos que deben ser abordados de manera responsable. Encontramos el caso del uso inapropiado de la IA para realizar las tareas, además de suponer un peligro al usarse de forma irresponsable, es necesario cuidar de forma exhaustiva el contenido y el uso que le dan los estudiantes a la IA.

Alguno de los impactos más destacados de la IA en la educación son:

Personalización del aprendizaje: La IA puede analizar las necesidades de aprendizaje de cada estudiante y adaptar el contenido educativo a su ritmo y estilo de aprendizaje. Esto ayuda a los estudiantes a trabajar en áreas donde necesitan más apoyo y avanza más rápidamente en aquellas donde ya son competentes.

Tutores virtuales y asistentes de aprendizaje: Los sistemas de IA pueden actuar como tutores virtuales, ofreciendo apoyo adicional fuera del aula. Estos sistemas pueden responder preguntas, proporcionar explicaciones adicionales y ofrecer ejercicios para práctica adicional, todo ello disponible 24/7.

Automatización de tareas administrativas: La IA puede encargarse de tareas administrativas que consumen mucho tiempo, como informes expertos externos y la gestión de horarios, liberando a los educadores para que se concentren más en la enseñanza y menos en la burocracia.

Evaluación y seguimiento del progreso: Los sistemas de IA pueden evaluar el progreso de los estudiantes de manera más eficiente y precisa, identificando áreas de mejora y adaptando los planes de estudio para abordar estas necesidades. Esto permite una retroalimentación instantánea y personalizada que puede ser crucial para el proceso de aprendizaje.

Accesibilidad: La IA puede hacer que la educación sea más accesible para estudiantes con discapacidades mediante la creación de interfaces adaptativas, programas de lectura, y otros recursos tecnológicos diseñados para satisfacer necesidades específicas.

Enriquecimiento del contenido educativo: La IA también se utiliza para desarrollar contenido educativo más interactivo y atractivo, como simulaciones y juegos educativos que pueden hacer que el aprendizaje sea más divertido y efectivo.

Detección de lagunas en el contenido: La IA puede analizar grandes volúmenes de datos de aprendizaje para identificar tendencias y lagunas en el contenido educativo, ayudando a los educadores a mejorar los materiales de enseñanza y los currículos.

Formación docente: Los sistemas de IA pueden ayudar en la formación de docentes, proporcionando simulaciones pbc y entornos de práctica que les permiten mejorar sus habilidades pedagógicas en un entorno controlado.

La falta de diversidad en el desarrollo de la IA

Nos encontramos ante un momento clave en donde la industria de la inteligencia artificial debe regular cómo continuar creciendo y garantizar a la vez que este crecimiento no amplíe desigualdades.

Ser conscientes de que los sistemas de inteligencia artificial tratan a las personas de forma distinta en base a sesgos, es un primer paso. A partir de aquí serán necesarios acuerdos transversales de la industria para garantizar desarrollos justos.

Aunque también es cierto que el aspecto cultural de los sesgos es responsabilidad de todos, ya que la IA los hereda del aprendizaje de la cultura en la que opera y que nos involucra a todos.

Por ello, es también una oportunidad para revisar cómo contribuimos cada uno de nosotros a perpetuar paradigmas de desigualdad: ¿solo no sentimos cómodos ante iguales? ¿o podemos sentirnos inspirados ante la diferencias con otros?. Una sociedad más sana, tolerante e inclusiva, trasferiría estos valores a cualquier producción humana, incluida la IA.

Como cualquier herramienta, del uso que le demos va a depender el impacto que ejercerá en la sociedad. También hemos visto como la IA ha contribuido a una reducción de la pobreza, por ejemplo, informando a granjeros sobre cuales son los precios justos y los cultivos que pueden ser más rentables, a través de predicciones meteorológicas precisas.

Por esto, una reflexión ética es indispensable para seguir avanzando. Todos tenemos una responsabilidad a la hora de garantizar que los beneficios de estas innovaciones nos encaminen hacia un futuro donde todos caben.